Biohub 단백질 월드 모델 해설: AI 신약 설계는 구조 예측보다 실험 검증 루프를 먼저 고정해야 하는 이유

Biohub가 공개한 ESMC, ESMFold2, ESM Atlas는 단백질 AI를 구조 예측 경쟁에서 후보 탐색과 실험 검증 루프로 확장한다. 오픈 모델을 신약 설계 파이프라인에 붙일 때 봐야 할 구조, 비교 기준, 실패 방지 체크리스트를 정리한다.

AI 뉴스, 개발 정보, AI 활용법을 정리합니다. 단순 요약보다 실무 적용성과 검증 포인트를 중심으로 콘텐츠를 큐레이션합니다.

운영 정책과 문의 채널은 소개, 개인정보처리방침, 이용약관, 문의에서 확인할 수 있습니다.

START HERE

Biohub가 공개한 ESMC, ESMFold2, ESM Atlas는 단백질 AI를 구조 예측 경쟁에서 후보 탐색과 실험 검증 루프로 확장한다. 오픈 모델을 신약 설계 파이프라인에 붙일 때 봐야 할 구조, 비교 기준, 실패 방지 체크리스트를 정리한다.

CodeGraph v0.9.5는 코드베이스 탐색을 파일 검색 반복에서 로컬 지식그래프 조회로 옮기려는 개발자 도구입니다. 이 글은 AI 코딩 에이전트에 CodeGraph를 붙일 때의 구조, 실행 절차, 비교 기준, 실패 방지 기준을 실무 관점으로 정리합니다.

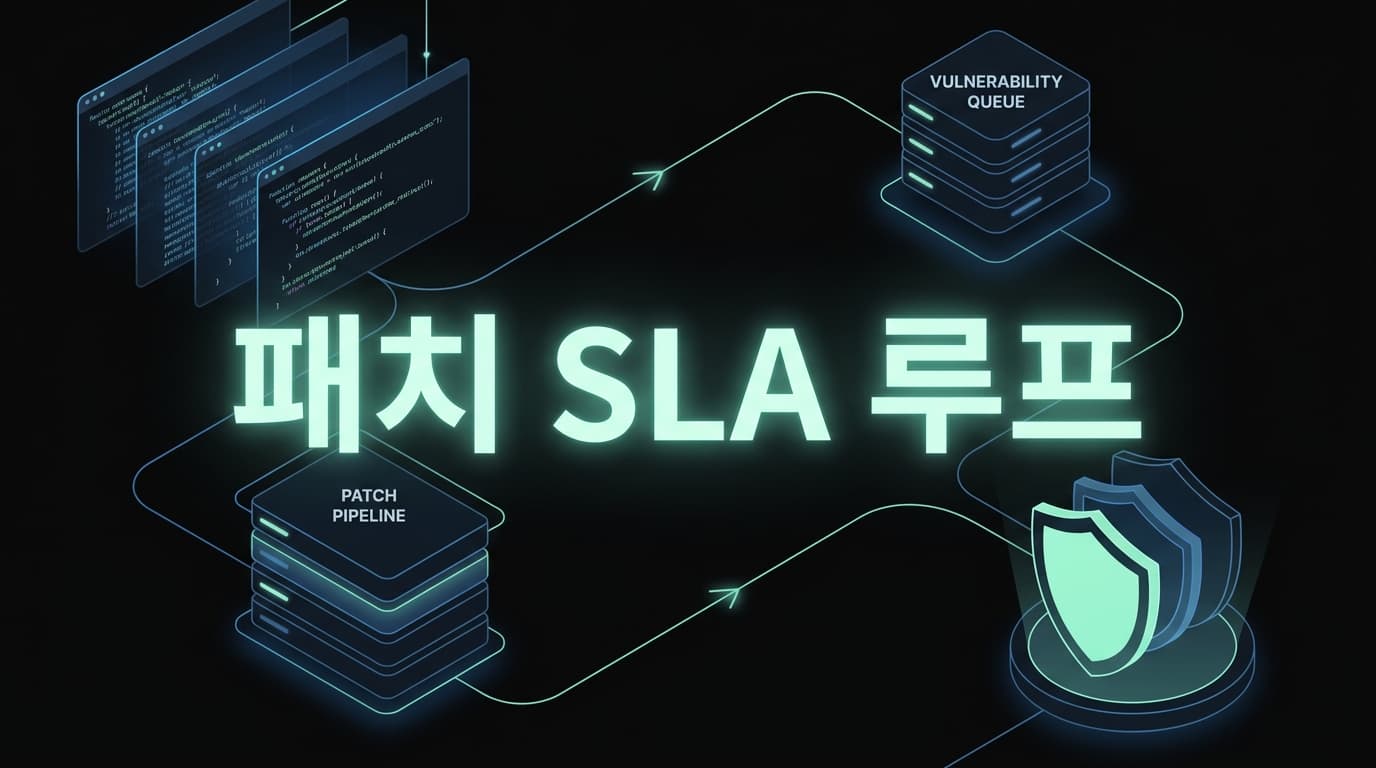

Frontier AI 보안 스캔은 취약점을 더 많이 찾는 기술이 아니라, 재현 큐·패치 SLA·노출 축소 루프를 통해 개발팀이 실제로 고칠 수 있게 만드는 운영 체계다.

EU AI Act의 2026년 적용 일정을 개발자 관점에서 해석하고, AI 서비스가 지금부터 고정해야 할 로그 스키마, 평가 게이트, 운영 증거 기준을 실전 체크리스트로 정리합니다.

코히어 Command A+ 공개는 단순한 새 오픈 모델 소식이 아니라, 기업이 에이전트 모델을 자체 인프라에서 어디까지 운영할 수 있는지 묻는 사건입니다. 218B MoE, 25B 활성 파라미터, W4A4 양자화, 도구 호출, RAG, 멀티모달을 기준으로 도입 판단 기준을 정리합니다.

Cloudflare AI Search의 built-in storage, vector index, web crawling, 관리형 마이그레이션을 기준으로 RAG 앱의 한도·비용·검색 품질 경계를 실무 관점에서 정리했습니다.

AI타임스가 보도한 우리데이터클리닉 V1.0 출시를 계기로, 공공기관 데이터가 AI에 바로 쓰이려면 왜 일반 기업 데이터 정제와 다른 기준이 필요한지 실무 도입 절차로 정리했습니다.

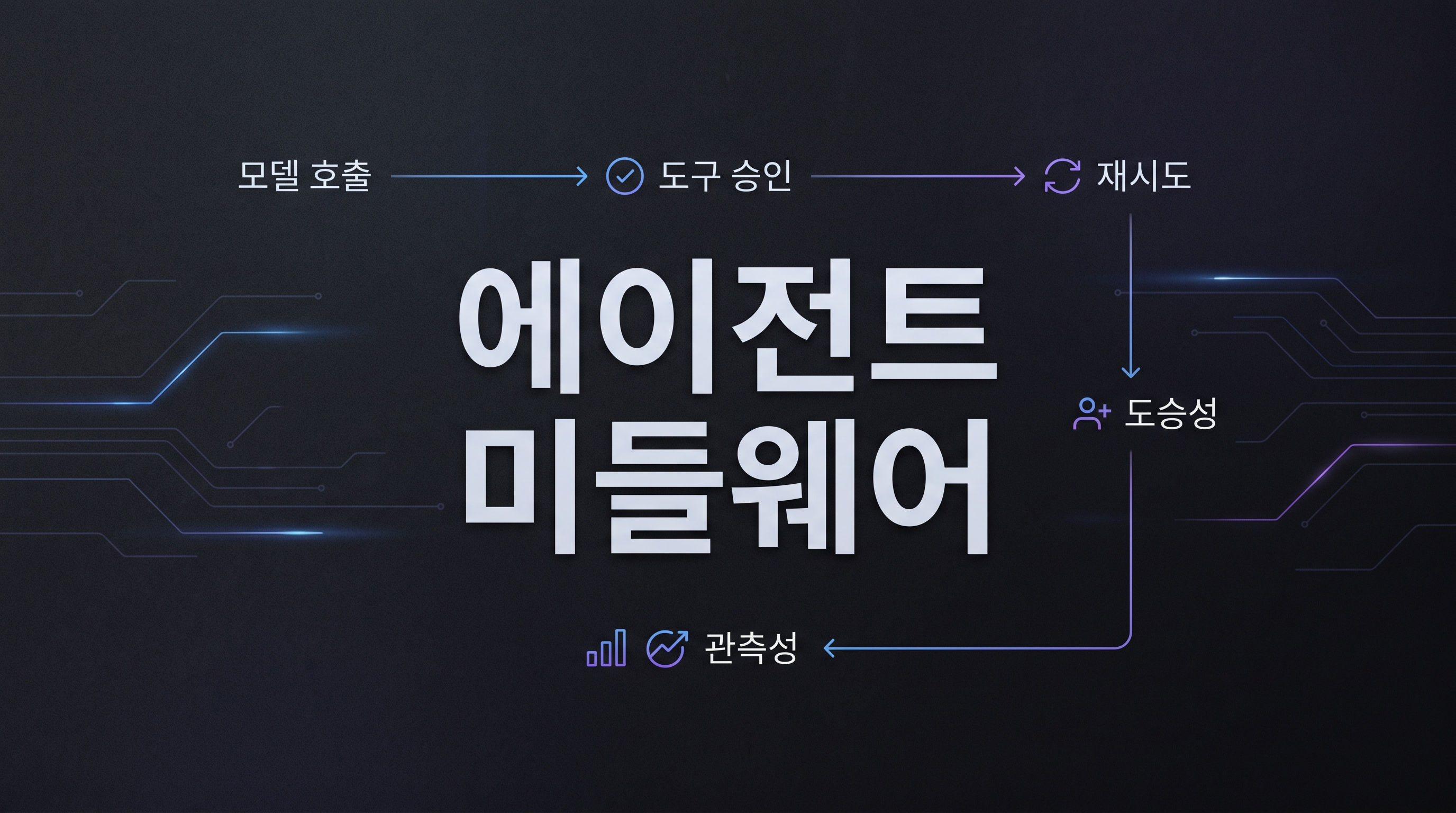

Google Genkit Middleware는 에이전트 앱의 재시도, 모델 폴백, 도구 승인, 파일 접근, 스킬 주입을 generate() 호출 주변의 공통 계층으로 분리합니다. 이 글은 프롬프트 규칙·직접 if문·그래프형 오케스트레이션과 비교해 실제 도입 기준을 정리합니다.

Anthropic와 Gates Foundation의 2억달러 파트너십은 공공영역 AI 경쟁의 초점이 모델 성능이 아니라 현장 데이터 연결, 평가 기준, 로컬 언어 배포 인프라로 이동했음을 보여준다. 의료·교육·농업 도입팀이 지금 무엇을 먼저 설계해야 하는지 실행 기준으로 정리했다.