GitHub Agent HQ 실전 운영 가이드: 14일 안에 팀 생산성 올리는 도입 플레이북

2026년 개발팀의 핵심 과제는 AI 코드 생성이 아니라 안전한 검증 자동화다. GitHub Agent HQ를 PR·CI·권한 정책에 연결해 14일 내 운영 가능한 형태로 도입하는 실무 방법을 정리했다.

1) 문제 정의: AI 코딩 에이전트는 붙였는데, 팀 생산성은 왜 안 오를까?

대상 독자는 5~50명 규모 개발팀의 테크리드·엔지니어링 매니저·플랫폼 엔지니어입니다. 2026년에는 "코드 자동 생성"보다 에이전트 운영 체계가 생산성을 결정합니다. 특히 GitHub Agent HQ/IDE 에이전트 도입 후에도 품질·리뷰 병목·보안 이슈가 발생하는 팀이 많습니다.

이 글은 "어떻게 에이전트를 프로덕션 개발 프로세스에 안전하게 넣을지"를 다룹니다. 범위는 GitHub 중심 운영(이슈→PR→CI→배포)이며, 제외 범위는 특정 모델 벤치마크 수치 경쟁입니다.

2) 근거/비교: 도입 방식 3가지와 선택 기준

왜 지금 이 주제가 중요한가 (2026년 2월 흐름)

- GitHub가 Claude/Codex 기반 에이전트 프리뷰를 공개하며 "레포 안에서 병렬 에이전트 작업"을 공식화

- Anthropic/OpenAI 진영 모두 에이전트 워크플로우 통합을 가속

- 실제 병목이 "작성 속도"에서 "검증·승인·롤백"으로 이동

X(구 트위터) 인플루언서/공식 계정 체크 결과

공식 채널(@github, @AnthropicAI, @OpenAI) 및 업계 반응 요약 기사 기준으로, 2월 핵심 메시지는 동일합니다. 단일 모델 우위보다 다중 에이전트 협업과 거버넌스가 제품 경쟁력이라는 점입니다.

| 운영안 | 설명 | 비용 | 시간 | 품질/정확도 | 난이도 | 권장 팀 |

|---|---|---|---|---|---|---|

| A. IDE 보조 중심 | 개발자 로컬에서만 에이전트 사용 | 낮음 | 빠름 | 중간 | 낮음 | 초기 도입팀 |

| B. PR 단위 에이전트 + CI 게이트 | 에이전트가 PR 생성, CI에서 정책 검증 | 중간 | 중간 | 높음 | 중간 | 일반 SaaS 팀 |

| C. 다중 에이전트 병렬 + 릴리즈 승인 체계 | 설계/구현/테스트 에이전트 분업 | 중~높음 | 빠름(스케일 시) | 높음 | 높음 | 멀티팀 조직 |

실무 권장: 대부분 팀은 B로 시작해, 장애율·리드타임이 안정화되면 C로 확장하는 것이 손실이 적습니다.

3) 단계별 실행: 14일 도입 플랜

Step 1. 에이전트 작업 범위를 PR 템플릿으로 제한

"무엇이 자동화 대상인지"를 먼저 고정합니다. 예: 테스트 보강, 문서화, 리팩터링.

## Agent Scope

- allowed: test, docs, refactor(no schema change)

- forbidden: payment/auth core logic without human approval

Step 2. GitHub Actions에 품질 게이트 추가

name: agent-pr-gate

on: [pull_request]

jobs:

quality:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v4

- run: pnpm install --frozen-lockfile

- run: pnpm lint && pnpm typecheck && pnpm test

Step 3. 에이전트별 역할 분리

- Agent-Author: 구현/수정

- Agent-Reviewer: 보안/성능 체크

- Human Approver: 배포 승인

Step 4. 실패 비용 측정 지표 운영

주간 대시보드에 아래 4개를 고정하세요.

- PR 리드타임(생성→머지)

- CI 실패율

- 릴리즈 후 회귀 버그율

- 롤백 횟수

Step 5. 위험 변경은 Human-in-the-loop 강제

DB 스키마, 결제, 인증, 권한 로직은 반드시 사람 승인 없이는 머지되지 않도록 브랜치 보호 규칙을 설정합니다.

4) 함정/실수 4가지 + 예방/복구

- 실수 1: "에이전트가 작성했으니 빠르게 머지"

예방: 코드오너 승인 + CI 통과를 이중 조건으로 설정. 복구: 최근 자동 머지 PR을 역추적해 고위험 영역 재검증. - 실수 2: 지표 없이 체감 생산성만 판단

예방: 리드타임/회귀율/롤백률 주간 리포트. 복구: 도입 전 2주 기준선과 비교해 정책 재설계. - 실수 3: 에이전트 권한 과다 부여

예방: 최소 권한 원칙, 쓰기 권한 분리. 복구: 토큰 로테이션 + 권한 재설정 + 감사로그 점검. - 실수 4: 한 번에 C모델(고난도 운영)로 점프

예방: B모델에서 2주 안정화 후 확장. 복구: 병렬 에이전트 수를 절반으로 축소해 재학습.

5) 실행 체크리스트 (DoD 포함)

- PR 템플릿에 에이전트 허용 범위를 명시했다. DoD: 모든 신규 PR에 Scope 섹션 표시.

- CI 게이트(lint/typecheck/test)가 강제된다. DoD: 실패 PR은 머지 차단 확인.

- 코드오너/브랜치 보호 규칙을 설정했다. DoD: 고위험 파일 경로 human review 필수.

- 주간 지표 대시보드 4종을 생성했다. DoD: 지난 2주 추세 비교 가능.

- 롤백 플레이북을 문서화했다. DoD: 30분 내 롤백 리허설 통과.

- 에이전트 권한 점검 루틴을 만들었다. DoD: 월 1회 권한 감사 로그 기록.

6) 참고자료 (링크 + 날짜)

- GitHub Changelog, Claude/Codex 공개 프리뷰 공지 (2026-02-04): https://github.blog/changelog/2026-02-04-claude-and-codex-are-now-available-in-public-preview-on-github/

- InfoWorld, GitHub Agent HQ 프리뷰 분석 (2026-02): https://www.infoworld.com/article/4130352/github-previews-support-for-claude-and-codex-coding-agents.html

- Help Net Security, GitHub coding agents 도입 요약 (2026-02-05): https://www.helpnetsecurity.com/2026/02/05/github-enables-coding-agents/

- Anthropic News, Claude 4.6 업데이트 (2026-02): https://www.anthropic.com/news/claude-opus-4-6

- Builder.io, 2026 개발자 AI 도구 운영 관점 정리 (2026): https://www.builder.io/blog/best-ai-tools-2026

7) 작성자 관점: 2026년 개발팀의 승부는 "코드 생성량"이 아니라 "검증 자동화율"입니다

추천: 대부분 팀은 B안(PR 단위 에이전트 + CI 게이트)를 기본 운영모델로 채택하세요. 속도와 안정성의 균형이 가장 좋습니다. 비추천: 지표·권한 정책 없이 C안부터 시작하는 방식입니다.

예외적으로, 플랫폼팀이 성숙하고 배포 빈도가 매우 높은 조직은 C안을 빠르게 적용해도 됩니다. 단, 이 경우에도 고위험 변경의 human approval 예외는 두지 않는 것이 안전합니다.

에이전트를 많이 쓰는 팀이 이기는 게 아니라, 에이전트가 만든 변경을 가장 빠르고 안전하게 검증하는 팀이 이깁니다.

공유하기

관련 글

Biohub 단백질 월드 모델 해설: AI 신약 설계는 구조 예측보다 실험 검증 루프를 먼저 고정해야 하는 이유

Biohub가 공개한 ESMC, ESMFold2, ESM Atlas는 단백질 AI를 구조 예측 경쟁에서 후보 탐색과 실험 검증 루프로 확장한다. 오픈 모델을 신약 설계 파이프라인에 붙일 때 봐야 할 구조, 비교 기준, 실패 방지 체크리스트를 정리한다.

CodeGraph v0.9.5 해설: AI 코딩 에이전트는 grep을 더 많이 돌리기보다 로컬 코드 지식그래프와 최신성 신호를 먼저 붙여야 하는 이유

CodeGraph v0.9.5는 코드베이스 탐색을 파일 검색 반복에서 로컬 지식그래프 조회로 옮기려는 개발자 도구입니다. 이 글은 AI 코딩 에이전트에 CodeGraph를 붙일 때의 구조, 실행 절차, 비교 기준, 실패 방지 기준을 실무 관점으로 정리합니다.

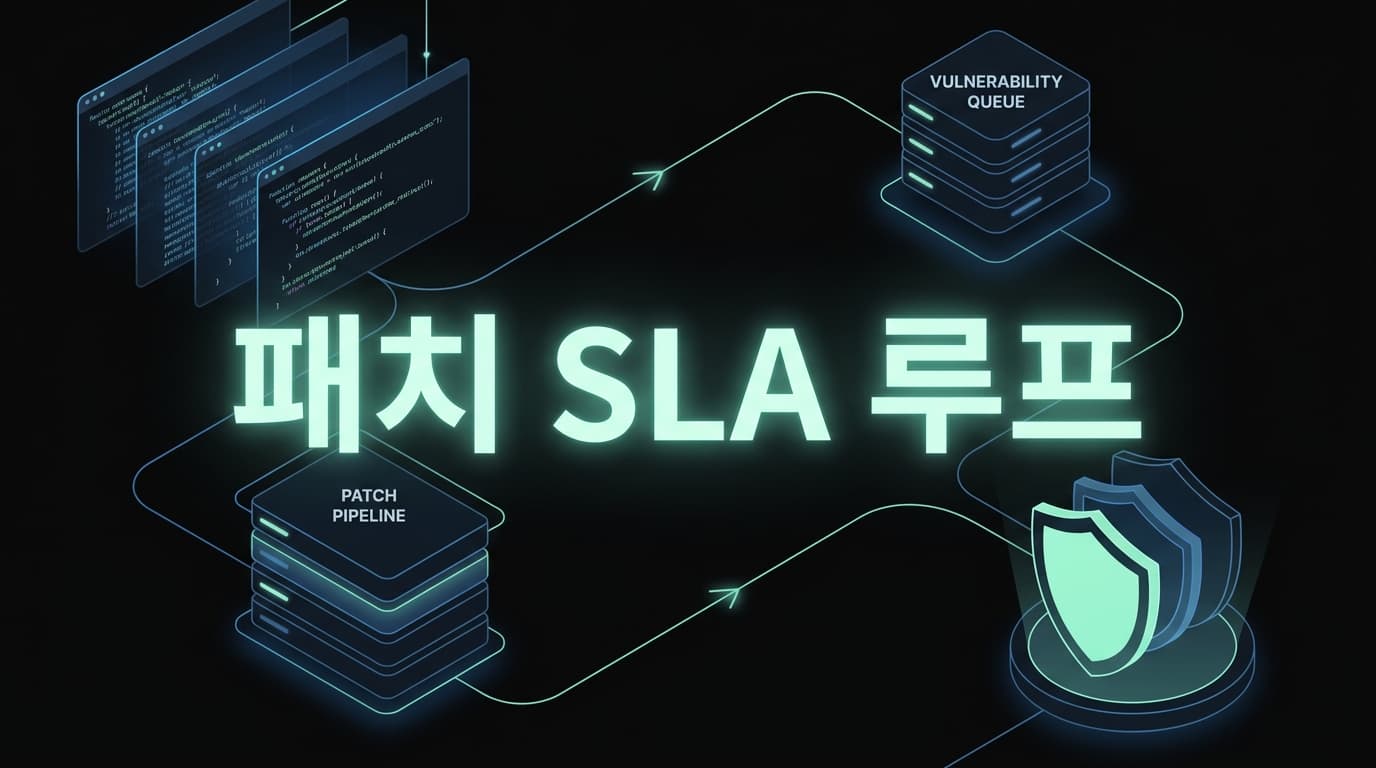

Frontier AI 보안 스캔 운영 가이드: 취약점 발견보다 재현 큐·패치 SLA·노출 축소 루프를 먼저 설계해야 하는 이유

Frontier AI 보안 스캔은 취약점을 더 많이 찾는 기술이 아니라, 재현 큐·패치 SLA·노출 축소 루프를 통해 개발팀이 실제로 고칠 수 있게 만드는 운영 체계다.

AQ 테스트 해보기

지금 내 AI 활용 능력이 어느 수준인지 3분 안에 확인해보세요. 인지력, 활용력, 검증력, 통합력, 윤리감을 한 번에 진단하고 맞춤형 인사이트를 받아볼 수 있습니다.

무료 AQ 테스트 시작하기